伯克希尔・哈撒韦公司董事长沃伦・巴菲特(Warren Buffett)是白银市场的长期研究者。1997年至1998年,当白银价格徘徊在每盎司5美元左右时,该公司对白银进行了巨额投资。

来源 | 划要点KeyPoints

作家|常远

剪辑|要点君

3月17日凌晨,2026年英伟达GTC大会在圣何塞正经开幕。黄仁勋暗示,要援救将来数兆好意思元规模的智能经济,必须从系统工程的视角重新遐想扫数这个词筹办堆栈。英伟达正试图通过全面掌控能源、芯片、基础设施、模子、应用这五层蛋糕,完成从芯片制造商到AI期间发电商的历史性障碍。

而对于AI期间程度的判断,黄仁勋抛出了一个极其浩大的产业愿景:单纯的数字生成期间正在走向深化,咱们正在迎来物理AI的大爆炸以及代理式AI的全面普及。要是说当年几年AI只是在屏幕内作答,那么从2026年运行,AI将领有在三维物理寰宇中行动与交互的实体技艺,并具备自主履行复杂任务的代理系统。英伟达正试图通过软硬一体化的全栈生态,再次重新界说筹办基础设施。

咱们梳理了这场发布会的中枢信息,以下是要点内容:

1. 算力需求重估:到2027年筹办阛阓规模将突破1万亿好意思元

黄仁勋在演讲中为AI基础设施的将来需求定下了基调:到2027年,全球筹办需求将突破1万亿好意思元大关。他强调,在这个全新的AI期间,Token(词元)即是新的基础货币。生成Token的老本与效直露接决定了科技企业的营收与存一火。英伟达戮力于打造全球每Token老本最低的筹办决策,因为这关乎扫数这个词行业运转的经济学底层逻辑。

2.加快筹办才是期间谜底:Vera Rubin平台全面接棒筹办霸权

面对外界对摩尔定律闭幕的商量,黄仁勋给出的谜底是约束进化的加快筹办架构。继Blackwell之后,下一代Vera CPU + Rubin GPU架构(Vera Rubin Ultra)正经成为全场焦点。

这一专为AI代理系统打造的平台展现了惊东说念主的扩展技艺,省略在一个系统中通顺多达144个GPU,并竣事了硬件与软件的透澈垂直整合。在能效与酬金率方面,这一新架构的潜力令东说念主隐敝,勾通全面普及的液冷期间(Liquid Cooling)和封装光学器件(Co-packaged optics),新架构不仅极大优化了能耗比,更被预期能为企业带来高达5倍的营收产出比,进一步闲隙了英伟达在数据中心领域的绝对总揽力。

3. 闲隙图图形与生态护城河:CUDA二十周年蓄积数亿GPU装机,DLSS 5也快来了

除了硬核的AI基建,英伟达的传统艺能同样在捏续进化。时值CUDA生态出身20周年,CUDA已在全球范围内累积了数亿GPU的装机量,并浸透进了每一个期间生态中,飞轮正在以前所未有的速率加快运转。同期,大会还理会了处于研发前沿的DLSS 5期间,预示着基于神经渲染的期间迭代将再次颠覆AI驱动的图形和高端游戏体验。

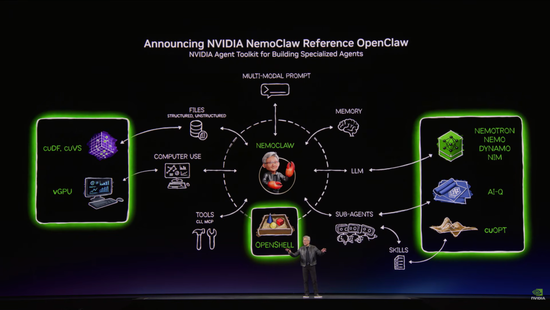

聚富网配资4. 押注代理式AI:推出NemoClaw,构建AI Agent的专用操作系统

在软件与生态侧,英伟达正经推出了NemoClaw参考堆栈。这相配于为代理式筹办机打造了一个专用的操作系统底座。借助NemoClaw,开发者省略在保险底层阴事与安全的前提下,通过肤浅的指示快速构建、部署和加快属于我方的个性化AI Agent。这绚丽着AI的交互逻辑正在发生根人道转变:从被迫反应的对话器具,进化为具备自主缱绻和履行技艺的超等个东说念主助理。

5.物理AI大爆炸:从自动驾驶到具身智能的全面落地

通用讲话模子并不是智能的止境,真的的下一代AI必须领有物理体格。黄仁勋强调了物理AI(Physical AI)的主张,AI必须学会贯通重力、摩擦力以及复杂的三维物理空间。

在自动驾驶领域,比亚迪、当代、日产等头部车企已纷繁加入英伟达的Robotaxi就绪平台;而在通用机器东说念主领域,英伟达发布了专为东说念主形机器东说念主打造的通用基础模子 Project GR00T。它省略让机器东说念主通过不雅察东说念主类行动来学习天然讲话和效法动作。此外,英伟达还大幅更新了Isaac机器东说念主平台,推出了专为机械臂抑止和3D视觉环境感知打造的全新软硬件库。英伟达与迪士尼幻想工程合作打造的《冰雪奇缘》雪宝(Olaf)实体机器东说念主也踏上GTC舞台,与黄仁勋亲密互动。

在演讲的最后,黄仁勋的愿景已不再局限于传统的硬件厂商鸿沟,英伟达正在构建总揽下一个期间的AI工场。从底层的Vera Rubin超算集群,到NemoClaw代理操作系统,再到物理机器东说念主生态,英伟达正试图包揽AI赋能现实寰宇的每一层基础设施,让加快筹办像一百多年前的电力一样,透澈融入东说念主类娴雅的日常运转之中。

以下为黄仁勋演讲内容全文:

1. 接待来到GTC:商量AI生态与“五层蛋糕”架构

接待来到GTC!我只想提醒全球,这是一场期间大会。这样多东说念主在黎明就排起了长队,很精练见到在座的诸位。在GTC咱们将商量期间与平台。NVIDIA领有三大平台,全球可能以为咱们主要磋磨的是CUDA X,但系统是咱们的另一个平台,现在咱们还有一个名为AI Factories的新平台。咱们将磋磨扫数这些内容,但最要紧的是咱们要磋磨生态系统。

在运行之前,我要感谢赛前节目主捏东说念主Sarah Go和Alfred Lin,以及NVIDIA的首家风险投资机构Sequoia Capital的Gavin Baker。行为首位主要机构投资者,他们深耕期间领域,知悉行业动态,领有平淡的期间生态系统。天然也要感谢我亲手挑选并邀请的诸位全明星VIP嘉宾,此外我还要感谢扫数到场的赞助公司。NVIDIA是一家平台公司,领有期间、平台以及丰富的生态系统。今天这里荟萃了全球100万亿好意思元产业的代表,共有450家公司赞助了本次行动,领有一千场期间分会和2000位演讲嘉宾。

本次大会将涵盖东说念主工智能五层蛋糕架构的每一层,从地盘、电力和建筑等基础设施,到芯片、平台和模子,而最终让扫数这个词行业升起的将是扫数的应用圭臬。

2. CUDA问世20周年:强大装机量驱动飞轮效应

一切都始于这里,本年是CUDA问世20周年。20年来咱们一直戮力于这一架构的研发。这项立异性的发明通过单指示多线程编写标量代码即可繁衍出多线程应用,这比SIMD更容易编程。咱们最近还添加了Tiles,以匡助开发者对Tensor Core及现在东说念主工智能基础数学结构进行编程。目下已独特千个器具、编译器、框架、库和数十万个公开的开源模式,CUDA一经深度集成到每一个生态系统中。最难竣事的少量是强大的装机量。

咱们花了20年时辰在全球构建起数以亿计运行CUDA的GPU和筹办系统,覆盖了每一个云平台和筹办机公司,就业于简直扫数行业。CUDA的装机量恰是推动飞轮加快动弹的中枢能源。装机量眩惑了开发者,开发者随后创造出如深度学习等竣事突破的新算法。这些突破催生了全新阛阓并建立起新的生态系统,眩惑更多公司加入,从而创造了更大的装机量。这种飞轮效应目下正在加快,NVIDIA库的下载量正以惊东说念主的速率增长。这种效应不仅让筹办平台能支捏稠密应用和突破,还赋予了基础设施极长的使用寿命。

有如斯多的应用不错在NVIDIA CUDA上运行,咱们支捏AI生命周期的每个阶段和每个数据处理平台,加快各式基于科学旨趣的求解器。正因应用范围如斯之广,一朝装配NVIDIA GPU,其使用寿命周期就极长。这亦然为什么早在六年前出货的Ampere架构在云表的订价依然在高潮。高装机量、权贵的飞轮效应和极广的开发者覆盖范围,加上咱们捏续更新软件,使得筹办老本约束下落。加快筹办极大普及了应用速率,跟着咱们在软件生命周期内的捏续培育和更新,用户不仅能赢得初度使用的性能普及,还能赢得加快筹办带来的捏续老本指责。因为装机量强大,咱们发布的新优化决策能惠及数以百万计兼容架构的GPU,覆盖全球用户。动态组合扩大了NVIDIA架构的影响力,加快增长的同期指责了筹办老本并促进新增长,这即是CUDA的中枢价值。

但咱们的旅程实验上始于25年前的GeForce。GeForce是NVIDIA最伟大的营销行动,好多东说念主是跟随它长大的。早在你们我方职守得起之前,父母就付钱让你们成为了NVIDIA的客户,直到有一天你们成为出色的筹办机科学家和真的的开发者。GeForce莳植了今天的NVIDIA并生长了CUDA。25年前咱们发明了全球首款可编程加快器——像素着色器,旨在让加快器具备可编程性。5年后CUDA出身了。咱们当年倾尽全公司利润所作念的最大投资,即是凭借GeForce将CUDA蔓延到每台电脑上。历经20年和13代居品,CUDA现已无处不在。十年前咱们推出了RTX,针对当代筹办机图形期间透澈重新遐想了架构。GeForce将CUDA推向寰宇,也让稠密前驱发现GPU是加快深度学习的良师汉典,从而开启了AI大爆炸。十年前咱们决定会通可编程着色期间并引入硬件晴明跟踪,其时咱们就以为AI将透澈变革筹办机图形学。正如GeForce将AI带给寰宇,现在AI将反过来透澈变革筹办机图形学。

今天我将展示下一代图形期间——神经渲染,这是3D图形与东说念主工智能的会通,也即是DLSS 5.0。咱们会通了可控的3D图形、杜撰寰宇的结构化数据与生成式AI的概率筹办。结构化数据无缺受控,勾通生成式AI,创造出雅致令东说念主咋舌且具备可控性的内容。这种将结构化信息与生成式AI会通的主张将接连约束地影响各个行业,结构化数据恰是值得相信的AI的基石。

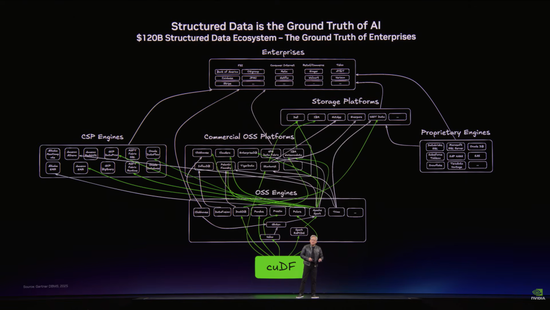

接下来咱们要详实商量结构化数据。全球熟知的SQL、Spark、Pandas、Velox以及Snowflake、Databricks、Amazon EMR、Azure Fabric、Google Cloud BigQuery等超大型平台都在处理数据框。这些数据框是巨大的电子表格,保存着企业筹办和业务的单一真值。当年咱们努力加快结构化数据处理,以更低老本和更高频率让公司高效运行。将来AI将以极快的速率使用这些结构化数据库。除此以外,还有代表全球绝大部分信息的非结构化生成式数据库,如向量数据库、PDF、视频和演讲等。每年生成的90%的数据都口角结构化数据。直到现在由于缺少方便的索引面貌且难以贯通其含义,这些数据一直无法被高效查询和搜索。

现在咱们让AI来措置这个问题。应用多模态感知与贯通期间,AI省略阅读PDF并贯通其含义,将其镶嵌到可搜索和查询的更大结构中。为此NVIDIA创建了两个基础库:用于数据框和结构化数据的cuDF,以及用于向量存储和非结构化AI数据的cuVS。这两个平台将成为将来最要紧的平台,咱们正将其深度融入全球复杂的数据处理系统采集结。

3. 赋能全球企业与云就业:AI期间的加快筹办

今天咱们将发布几项要紧合作。IBM行为领域特定讲话SQL的发明者,正在使用cuDF加快watsonx的数据处理。60年前IBM推出了开启筹办期间的System/360,随后SQL和数据仓库组成了当代企业筹办的基石。今天IBM与NVIDIA正通过应用GPU筹办库加快watsonx.data的SQL引擎,为AI期间重新界说数据处理。由于刻下CPU数据处理系统已无法舒服AI对海量数据集的快速拜访需求,企业必须转型。举例雀巢每天要作念数千次供应链决策,在CPU上每天只可刷新几次汇总了全球寄托事件的订单到现款数据集市,而在NVIDIA GPU上运行加快的watsonx后,速率普及了5倍且老本指责了83%。

AI期间的加快筹办一经到来。咱们不仅加快了云表数据处理,也加快了土产货部署。全球首先的系统和存储制造商Dell与咱们合作,将cuDF和cuVS集成到Dell AI数据平台中以理睬AI期间。咱们还与Google Cloud合作加快了Vertex AI和BigQuery。在与Snapchat的合作中,咱们将其筹办老本指责了近80%。当你加快筹办和数据处理时,不仅赢得了速率和规模上风,最要紧的是赢得了老本上风。摩尔定律的中枢是性能每隔几年翻倍,但它现在一经潜力不及。加快筹办让咱们省略竣事跨越。

NVIDIA行为一家算法公司,凭借平淡的阛阓触达和强大的装机量,通过捏续优化算法约束指责筹办老本,为全球扩大规模并普及速率。NVIDIA构建了加快筹办平台并提供RTX、cuDF、cuVS等一系列库,最终将其集成到全球的云就业和OEM厂商中触达全球。这种合作模式正在Google Cloud、Snapchat等平台上约束重迭。咱们为在JAX、XLA和PyTorch上所作念的出色使命感到自重。咱们是全球独一在这些框架上都弘扬超过的加快器。像Baseten、CrowdStrike、Puma、Salesforce等不仅是咱们的客户亦然开发者。

咱们将NVIDIA期间整合到他们的居品中,并将他们带入云表。咱们与云就业提供商的相关实质即是为他们带来客户。大多数云就业提供商都极端乐意与咱们合作,因为咱们将一语气约束地为扫数东说念主提供加快。最后,本年让我极端原意的一件事是,咱们将把OpenAI引入AWS,这将带动AWS云筹办的巨大耗尽并扩展OpenAI的筹办技艺。

在AWS,咱们加快了EMR、SageMaker和Bedrock。NVIDIA与AWS进行了深度集成,他们亦然咱们的首个云合作伙伴。在Microsoft Azure方面,咱们为其打造并装配了首台NVIDIA A100超等筹办机,这为自后与OpenAI的巨大告捷合作奠定了基础。咱们与Azure的合作由来已久,不仅为其云就业和Bing Search提供加快,还与他们的AIFoundry开展了深度合作。跟着AI在全球范围内的扩展,Azure Regions的合作也变得极其要紧。咱们提供的一项中枢功能是私密筹办(Confidential Computing)。私密筹办省略确保操作员无法触碰或稽查数据和模子。NVIDIA GPU是全球首款竣事该功能的GPU,它省略支捏并在不同云表和地区安全部署OpenAI和Anthropic等极其难得的模子。这一切都要归功于至关要紧的私密筹办期间。

在客户合作方面,Synopsis是咱们的要紧合作伙伴,咱们正在加快其扫数的EDA和CAU使命流,并落地于Microsoft Azure。咱们既是Oracle的首家供应商,亦然他们的首位AI客户。让我极端自重的是,我首次向Oracle解释了AI云的主张,并成为了他们的首位客户,从那时起Oracle便运行升起。咱们在那儿落地了包括Quark、Cohere、Fireworks以及OpenAI在内的一多数合作伙伴。CoreWeave是全球首个AI原生云,其建立的中枢主见即是在加快筹办期间提供并托管GPU,为AI云提供托管就业。他们领有出色的客户群,况兼增长速率惊东说念主。

我还极端看好Palantir和Dell平台。咱们三家公司心心相印打造了一种全新类型的AI平台——Palantir Ontology平台。该平台不错在职何国度、任何物理攻击(air-gapped)区域竣事完全土产货化的现场部署。AI简直不错部署在职何方位。要是莫得咱们的私密筹办技艺,莫得咱们构建端到端系统以及提供扫数这个词加快筹办和AI堆栈的技艺(涵盖从向量或结构化数据处理到AI期间的完整过程),这一切都不行能竣事。这些例子展示了咱们与全球云就业提供商之间的特殊合作相关,他们今天都在现场,我至心感谢全球的忙绿付出。

4.NVIDIA的公司特色:垂直整合但同期横向绽放

NVIDIA是一家垂直整合但同期横向绽放的公司,这是全球会反复看到的主题。其必要性极端肤浅:加快筹办不单是是芯片或系统的问题,它的中枢在于应用加快。要是只是让电脑运行得更快,那是CPU的使命,但CPU一经潜力不及了。将来竣事巨大性能普及和老本指责的独一面貌,即是通过应用或特定领域的加快来竣事,即应用加快筹办。因此NVIDIA必须针对不同的垂直行业和领域,开发一个又一个的库。

行为一家垂直整合的筹办公司,咱们别无采纳,必须深入贯通应用、领域和算法的底层逻辑。咱们还必须弄了了怎样将算法部署在数据中心、云表、土产货(on-prem)、角落端或机器东说念主系统等各式千差万别的筹办系统中。从底层芯片到系统,咱们竣事了垂直整合。而NVIDIA之是以无比强盛,是因为咱们横向绽放。咱们戮力于将NVIDIA的软件、库和期间与合作伙伴的期间相勾通,集成到任何主见平台中,从而将加快筹办带给寰宇上的每一个东说念主。本次GTC大会恰是这一理念的绝佳展示。

目下咱们领有触达各大垂直领域的领域特定库,以措置九行八业的要道问题。举例在金融就业业(这亦然本届GTC参会东说念主数最多的群体),算法交游正从依赖东说念主类进行特征工程的传统机器学习,转向由超等筹办机分析海量数据并自动发现明察与模式,这恰是金融业的深度学习和Transformer时刻。医疗保健行业也迎来了ChatGPT时刻。咱们正在将AI物理学和AI生物学应用于药物研发,并开发用于客户就业和辅助会诊的AI Agent。

在工业领域,咱们正在开启东说念主类历史上规模最大的扩建工程,全球大多数行业都在建造AI工场,今天也有好多芯片和筹办机制造厂的代表来到现场。在媒体与文娱方面,及时AI平台正在支捏翻译、播送、直播游戏和视频,绝大部天职容都将通过AI进行增强。在量子筹办领域,有35家公司正应用咱们的Holoscan平台构建下一代量子GPU搀杂系统。零卖和消费品(CPG)行业正应用NVIDIA优化供应链,并构建代理式购物系统和客服AI Agent,这是一个价值35万亿好意思元的强大阛阓。

在规模达50万亿好意思元的制造业机器东说念主领域,NVIDIA已深耕十年,构建了重建机器东说念主系统所需的基础筹办机,并与扫数主流机器东说念主制造公司张开合作,这次展会咱们就展出了110台机器东说念主。电信行业的规模约为2万亿好意思元,其遍布全球的基站行为上一代筹办期间的基础设施,行将迎来透澈重塑。将来的基站将成为AI基础设施平台,让AI在角落运行。咱们的Aerial(即AIRAN)平台正在与Nokia、T-Mobile等多家公司开展要紧合作。

在这一切的中枢是咱们自主发明的CUDA-X库算法,这是NVIDIA行为一家算法公司的立身之本,亦然咱们区别于其他公司的特别之处。算法让咱们省略深入各个行业,将寰宇顶尖筹办机科学家措置问题的措施重构并转动为库。在本次展会上,咱们将发布大批库和模子,这些约束更新的库是咱们公司的瑰宝,它们激活了筹办平台,真的措置了实验问题。比如激发当代AI大爆发的cuDNN,以及用于决策优化的cuOPT、筹办光刻的cuLitho、径直稀零求解器的cuDSS、基因组学的Parabricks等上千个CUDA-X库,正助力开发者在科学和工程领域取得突破。全球所看到的一切都不是东说念主工动画,而是基于基础物理求解器、AI物理模子和物理AI机器东说念主模子的完全模拟。凭借对算法的贯通与筹办平台的勾通,NVIDIA行为一家垂直整合且横向绽放的公司,正约束解锁新机遇。

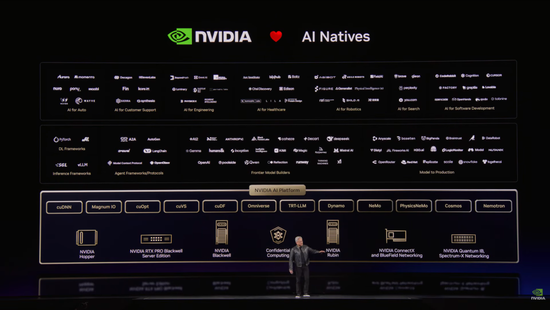

如今除了传统巨头,还暴露了一多数像OpenAI、Anthropic这样的AI原生(AInative)初创公司。跟着筹办被重新发明,创投圈向初创企业参加了史无先例的1500亿好意思元资金。因为历史上第一次,这些公司绝对需要强大的算力和海量的Token,他们要么我方生成Token,要么为现存的Token升值。正如PC、互联网和挪动云期间出身了Google、Amazon和Meta一样,咱们正处于新平台转型的开头,必将暴露出对将来具有要紧影响力的新公司。

当年两年的爆泉源于三大里程碑。首先,ChatGPT开启了生成式AI期间,它不仅能感知和贯通,还能翻译并生成原创内容。其次,生成式筹办透澈改变了筹办的竣事面貌,从当年的基于检索转变为现在的生成式,这也深刻改变了筹办机的架构和构建面貌。第三是推理AI的崛起,O1和O3模子的出现让AI省略反想、孤独想考、领会问题并进行自我考证,使生成式AI变得更值得相信且基于事实。这种推理技艺大幅增多了高下文输入和想考输出的Token使用量,权贵提高了筹办量需求。随后ClaudeCode行为首个智能体模子问世,它省略自动读取文献、编写代码、编译测试并迭代,透澈变革了软件工程。

咱们有100%的职工正在使用ClaudeCode、Codex和Cursor等运行在NVIDIA上的AI器具来辅助编写代码。现在,你不再需要究诘AI该作念什么,而是径直让它勾通高下文去创作、履行和构建。AI一经从感知进化到生成,再到推理,如今一经省略真的开展高效的使命。正因为AI终于省略进行坐褥性使命,当年两年阛阓对NVIDIAGPU的筹办需求透澈爆表,尽管咱们一经大批出货,但需求仍在捏续攀升。

AI现在必须想考、行动并进行阅读,而要作念到这些,它必须进行推理并进行逻辑推演。AI的每一个部分在想考、行动和生成Token时都必须进行推理。现在早已过了进修阶段,咱们正处于推理领域,推理的拐点一经到来。在这个时刻所需的筹办量增多了约莫10000倍。在当年的两年里筹办需求增长了10000倍,而使用量可能增长了100倍。相信筹办需求在当年两年里增长了一百万倍,这亦然每一家初创公司、OpenAI和Anthropic的共同感受。要是他们能赢得更多算力就能生成更多Token,营收就会增长,越先进的AI就会变得越机灵。

咱们现在正处于这个正向飞轮系统中,推理的拐点一经到来。旧年此时我说过到2026年Blackwell和Rubin的高置信度需乞降采购订单总和将达到5000亿好意思元。虽然全球可能因为创下年度营收记录而对这个数字不为所动,但我现在要告诉全球,到2027年这一数字将至少达到1万亿好意思元。事实上咱们将濒临算力短缺,筹办需求将远高于此。

5.NVIDIA的推理之年

咱们在当年一年里作念了大批使命,2025年是NVIDIA的推理之年。咱们但愿确保不仅擅出息修和后进修,而且在AI的每一个阶段都弘扬出色。对基础设施的投资不错历久扩展,NVIDIA基础设施使用寿命长且老本极低。毫无疑问NVIDIA系统是寰宇上老本最低的AI基础设施。旧年的一切都是围绕推理AI张开的,这推动了拐点的到来。同期Anthropic和Meta的Llama等代表全球三分之一AI开源模子算力的平台都采纳了NVIDIA。开源模子已接近前沿水平且无处不在。NVIDIA是现活着界上独一省略跨越扫数讲话和AI领域运行的平台,涵盖生物学、筹办机图形学、筹办机视觉、语音、卵白质、化学和机器东说念主期间等领域。咱们的架构从角落到云表通用,使其成为老本最低且最值得相信的平台。

面对一万亿好意思元的强大基础设施规模,必须确保投资具有高性能、老本效益和历久使用寿命。你不错满怀信心肠采纳NVIDIA,岂论部署在云表、土产货如故寰宇任何方位,咱们都能提供支捏。咱们现在是一个运行扫数AI的筹办平台,这已体现在业务中。咱们60%的业务来自前五大超大规模云就业商,其中一部分用于里面AI耗尽。推选系统和搜索等里面使命负载正从传统措施转向深度学习和大讲话模子,这些负载正向NVIDIA极具上风的GPU上挪动。通过与各大AI实验室合作并领有强大的原生生态系统,咱们能将算力带入云表并被速即耗尽。另外40%的业务遍布区域云、主权云、企业、工业领域、机器东说念主期间、角落筹办和超等筹办系统等。AI平淡的触达范围和种种性恰是其韧性所在,它现已成为一项基础期间和全新的筹办平台变革。

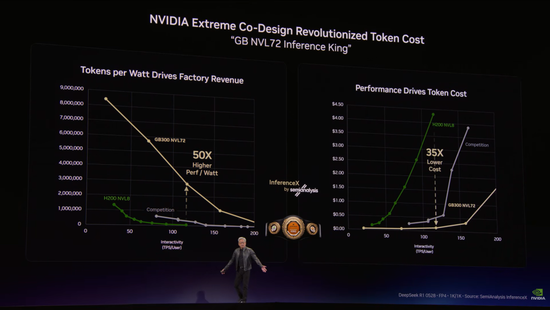

咱们的职责是连接推动期间越过。旧年行为推理之年,咱们在Hopper架构巅峰时冒着巨大风险进行了透澈重塑。咱们决定将架构普及到全新水平,透澈重构系统以解耦筹办并创造了NVLINK-72。其构建、制造和编程面貌都发生了透澈改变。GraceBlackwell和NVLINK-72是一场巨大的赌注,感谢扫数合作伙伴的忙绿努力。NVFP4不单是是精度上的普及,它代表了完全不同类型的TensorCore和筹办单位。咱们诠释了不错在不亏欠精度的情况下进行推理并大幅普及性能和能效,同期还能将其用于进修。勾通NVLINK-72、NVFP4、Dynamo、TensorRT-LLM以及一系列新算法,咱们以致参加数十亿好意思元建造了DGXCloud超等筹办机来优化内核和软件栈。当年东说念主们常说推理很肤浅,但实验上推理是终极难题,亦然驱动收入的中枢能源。对AI推理最全面的扫描数据夸耀每瓦特Token数至关要紧。每个数据中心都受到功率抑止,物理规章决定了1吉瓦的工场不行能酿成2吉瓦。因此必须在有限功率下产出最大数目的Token,勤勉处于效率弧线的尖端。

推理速率决定了反应速率,也即是单次推理的交互性。推理速率越快,能处理的高下文和想考的Token就越多,这等同于AI的智能程度和隐约量。AI越机灵,想考时辰变长,隐约量就会随之指责。从现在起,全寰宇的每一位CEO都会将业务视作Token工场并将其径直与收入挂钩。在给定功率下,更好的每瓦性能意味着更高的隐约量和更多的Token产出。NVIDIA领有全球最高的性能,摩尔定律蓝本预期带来1.5倍的普及,但咱们竣事了35倍的跨越。

旧年我说GraceBlackwell和NVLink72的每瓦性能普及了35倍时没东说念主相信,以致有分析师以为我保留实力实验普及高达50倍。这使得咱们的每Token老本成为全球最低。要是架构失实即使免费也不够低廉,因为建造并分管一个吉瓦级工场的老本高达400亿好意思元。必须部署最顶尖的系统以赢得最好老本效益。通过极致的协同遐想,咱们进行垂直整合并水平绽放,将扫数软件和期间打包给全球推理就业提供商。

举例Fireworks和Together等平台增长速即,坐褥效率即是他们的一切。在咱们更新软件后系统硬件不变的情况下,平均速率从每秒约700个Token普及到了接近5000个,整整提高了七倍。当年用于存储文献的数据中心现在一经酿成了受功率抑止的Token工场。推理是新的使命负载,Token是新的商品,筹办即收入。将来每一家云就业和AI公司都将想考其Token工场的效率,这种智能将由Token来增强。

6.算力十年跃迁与智能体超等引擎

回想当年十年的发展,咱们在2016年推出了全球首款专为深度学习遐想的筹办机DGX-1,八个Pascal架构GPU通过第一代NVLink通顺提供170Teraflops算力。随后通过Volta架构引入NVLink交换机,将16颗GPU行为巨型GPU运行。跟着模子增长数据中心需成为单一筹办单位,于是Mellanox加入了NVIDIA。2020年推出的DGXA100SuperPOD勾通了纵向与横向扩展架构。之后开启生成式AI期间的Hopper架构配备了FP8,而Blackwell通过NVLINK-72重新界说了AI超等筹办,竣事130TB/s的全对全带宽。

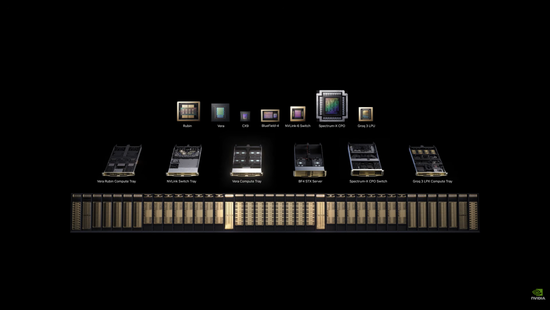

如今智能体系统的算力需求呈指数级增长。专为智能体AI遐想的VeraRubin鼓励了筹办领域的各个援救,佰朔资本提供3.6Exaflops算力和每秒260Terabytes的全对全带宽。搭配专为编排遐想的VeraCPU机架、基于BlueField-4的STX存储机架、普及能效的Spectrum-X交换机,以及增多Token加快器的Grock-3LPX机架,协力竣事了每兆瓦35倍的隐约量普及。这个包含七颗芯片、五台机架级筹办机的全新平台,让算力在短短10年内普及了4000万倍。

当年先容Hopper时我还能举起一颗芯片,但VeraRubin是一个需要合座优化的强大系统。智能体系统最要道的是大讲话模子的想考过程,模子约束增大对内存和存储系统产生了巨大压力,因此咱们重新发明了存储系统。AI需要器具尽可能快地运行,为此咱们打造了全新VeraCPU,它专为极高单线程性能遐想,是全球独一给与LPDDR5的数据中心CPU,能效比顾盼群雄。该CPU旨在与机架其他部分协同进行智能体处理。VeraRubin系统已竣事100%液冷,取消了线缆,装配时辰从两天镌汰至两小时。它使用45度温水冷却,大幅指责了数据中心的散热老本与能源耗尽。这是目下寰宇上独一构建到第六代的纵向扩展交换系统,竣事难度极高。此外给与共封装光学期间的Spectrum-X交换机也已全面量产,光子径直通顺芯片硅片,工艺完全是立异性的。VeraCPU行为孤茕居品已成为价值数十亿好意思元的业务。

这四个机架组成的系统通过结构化布缆构建,极为高效。而RubinUltra筹办节点则更进一步,装配进名为Kyber的全新机架中,可在一个NVLINK域中通顺144个GPU。筹办节点垂直插入中板,不再受限于铜缆的驱动距离,后头通顺NVLINK交换机,组成一台巨大的筹办机。最后再次强调,在给定的功率下AI工场的隐约量和Token生成速率将径直决定来岁的收入,这是对AI工场将来最要紧的一模式的。

纵轴是隐约量,横轴是Token速率。跟着Token生成速率的普及和模子规模的约束扩大,不同应用场景对Token和高下文长度的需求也在捏续激增。输入和输出的Token长度正从十万级别向数百万级别跨越。这些要素最终都将深刻影响将来Token的交易化营销与订价。

Token正在成为一种新的大量商品。像扫数大量商品一样,一朝期间走向纯属并到达拐点,阛阓就会出现细分。高隐约量但低生成速率的版块适用于免费层级;中等层级则会提供更大的模子、更快的生成速率以及更长的高下文输入窗口,对应不同的订价区间。正如全球在各种云就业中所见,从免费层级到每百万Token收费3好意思元、6好意思元的路子订价模式一经出现。

业界都在戮力于约束突破技艺范围,因为模子参数越大就越智能,输入的高下文越长则有关性越高。而在更快的生成速率下,系统能更好地进行想考与迭代,从而催生出更机灵的AI模子,每一次性能的跃升都赋予了就业更高的溢价空间。将来可能会出现收费高达45好意思元以致每百万Token收费150好意思元的高档模子就业,有益为处于要道研发旅途或进行历久复杂研究、对Token生成速率有极高条目的用户提供支捏。不外从现实来看,要是一个研究团队每天耗尽五千万个Token,以每百万150好意思元计价,这样的老本是难以承受的。但咱们笃信路子化与细分化即是AI产业的将来发展主见。AI期间必须从成立本身价值和实用性起步,约束迭代升级,将来大多数AI就业都将给与这种多层级的模式。

7. 从Hopper到Vera Rubin:突破性能与隐约量极限

回想Hopper架构,全球本就预期下一代居品质能会有所普及,但Grace Blackwell的飞跃幅度超乎扫数东说念主设想。Grace Blackwell在免费层级竣事了隐约量的极大普及,而这恰是企业竣事就业变现的中枢领域,其隐约量径直跃升了35倍。正如九行八业的交易逻辑一样:就业层级越高,对应的质地与性能越好,但可用容量相对越低。咱们在将基础层级性能普及35倍的同期,还引入了全新的就业层级,这即是Grace Blackwell相较于Hopper竣事的巨大跨越。

接下来登场的是Vera Rubin。在每一个细分就业层级上咱们都竣事了隐约量的飞跃。特别是在平均售价最高、最具交易价值的顶层细分阛阓中,咱们将隐约量普及了整整10倍。在顶尖领域竣事如斯幅度的性能跨越是极其贫窭的工程挑战。这恰是NVLink72的上风所在,亦然极低延迟架构带来的巨大红利。通过极致的软硬件协同遐想,咱们告捷拔高了扫数这个词行业的期间上限。

从客户的实验运营角度来看,假定一个数据中心只须1吉瓦的电力总容量,咱们需要进行缜密的算力分派:比如将各25%的算力分辨参加到免费、中级、高档和Premium层级中。免费层级用于获客,而顶层就业则面向最具价值的客户群,两者勾通最终转动为业务营收。在雷同的资源抑止下,Blackwell架构省略创造五倍以上的收入,而Vera Rubin同样能竣事五倍的营收增长。因此客户应该尽早向Vera Rubin架构挪动,这不仅能权贵普及隐约量,还能大幅指责单Token的生成老本。

8. 拥抱Groq:解耦推理与算力架构的深度会通

但咱们的追求不啻于此。竣事超高隐约量需要海量的FLOPS算力援救,而竣事极低延迟和高频交互则高度依赖强大的内存带宽。由于系统芯片的物理名义积老是有限的,筹办机架构时常难以同期兼顾极高的FLOPS与极致的带宽。在底层遐想上,优化高隐约量与优化低延迟实质上是互相矛盾的。

为了突破这一物理瓶颈,咱们收购了Groq芯片研发团队并赢得了有关期间授权。两边一直在贯彻永久整合系统架构。如今在最具交易价值的高端层级中,咱们将性能再度普及了35倍。NVIDIA之是以能在绝大多数AI使命负载中占据绝对的主导地位,根柢原因就在于咱们深刻贯通隐约量在这一领域的要紧性。NVLink72展现出了颠覆性的架构上风,它是目下最正确的期间旅途,即使在引入Groq期间后,其中枢性位依然坚如磐石。

然而要是咱们向外大幅延迟需求场景,假定你需要提供的就业不再是每秒400个Token,而是每秒1000个Token的超高速生成,NVLink72受限于带宽瓶颈将力不从心。这恰是Groq奋起直追的领域。Groq期间超越了现存极限,以致突破了NVLink72所能触及的性能天花板。要是将期间转动为实验收益,Vera Rubin的创收技艺是Blackwell的5倍。要是你的主要业务是高隐约量使命负载,我提出100%部署Vera Rubin;但要是你的业务波及大批代码编写或极高价值的Token生成任务,引入Groq将是理智之举。一种合理的资源建设是将Groq部署在约25%的数据中心节点中,剩余75%全部给与Vera Rubin。通过将两者深度会通,咱们不错进一步拓展系统的性能范围。

Groq的筹办系统之是以极具眩惑力,是因为它给与了笃定性的数据流处理器架构。它完全依赖静态编译和编译器颐养,由软件事先精确筹办并颐养履行时机,确保算力与数据同步到达。这种架构透澈舍弃了动态颐养并配备了海量的SRAM,是有益为AI推理这一单一使命负载量身定制的。跟着全球对超智能、高速Token的生成需求呈指数级爆发,这种系统集成的价值将日益突显。

在这个体系中存在着两种走向极点的处理器架构:一颗Vera Rubin芯片领有288GB的强大显存;而要是要承载Rubin级别的海量模子参数以及强大的高下文和KV缓存(KV Cache),则需要堆叠数目惊东说念主的Groq芯片。强大的内存需求曾一度抑止了Groq进入主流阛阓,直到咱们构想出一个绝妙的措置决策——通过一款名为Dynamo的软件竣事完全的解耦推理(Disaggregated Inference)。

咱们透澈重构了AI推理活水线的履行面貌。咱们将最擅长高隐约量筹办的任务交给Vera Rubin处理,同期将解码生成、低延迟反应以及受带宽瓶颈制约的使命负载卸载给Groq。就这样咱们将两种性情千差万别的处理器无缺归并。为了措置海量内存需求,咱们只需横向扩展大批Groq芯片来蔓延内存容量。对于万亿参数级别的超大模子,咱们不错将其完整部署在Groq芯片集群中;同期Vera Rubin在一旁协同使命,负责存储处理复杂智能体(Agentic AI)系统所需的强大KV缓存。

基于解耦推理的主张,Vera Rubin负责处理相对肤浅的预填充(Pre-fill)措施,而Groq则深度参与解码(Decode)过程。解码阶段入彀算密集的防御力(Attention)机制由Vera Rubin承担,而前馈采集(Feedforward Network)以及最终的Token生成则在Groq芯片上履行。这两大系统通过以太网(Ethernet)紧密耦合,并通过特殊传输模式将采集延迟削减了近一半。在这一强盛的硬件底座之上,咱们运行了专为AI工场打造的超过操作系统Dynamo,最终竣事了高达35倍的性能飞跃,更带来了全球前所未见的Token生成层级推感性能。这即是整合了Groq期间的新一代Vera Rubin系统。

在此我要特别感谢Samsung。他们为咱们代工制造了Groq LP30芯片,目下产线正在全力运转,芯片已全面进入量产阶段。瞻望在本年第三季度傍边,咱们还将发布升级版的Groq LPX。

回想以往,由于NVLink72架构的特别复杂性,Grace Blackwell在早期的样片测试阶段面最后巨大挑战;但Vera Rubin的测试使命鼓励得格外凯旋。正如Satya所秘书的,第一台Vera Rubin机架已在Microsoft Azure云平台上正经点亮运行。咱们在全球范围内构建了极其强盛的供应链体系,目下每周省略产出数千套此类强大系统,相配于每个月都能寄托数吉瓦规模的AI工场基础设施。在捏续寄托GB300机架的同期,咱们也在全面量产Vera Rubin机架。

与此同期Vera CPU也取得了空前的告捷。刻下AI在履行器具调用(Tool Use)等复杂操作时,依然高度依赖CPU的指示处理技艺,Vera CPU的架构遐想无缺契合了这一中枢诉求。Vera CPU与BlueField数据处理器以及CX9网卡深度整合,共同接入了BlueField-4采集堆栈生态。目下全球扫数的主流存储企业都在积极融入咱们的系统生态。当年是东说念主类在使用SQL查询调用数据,而将来将是海量的AI智能体在大肆读取存储系统。这些系统必须省略无缝支捏cuDF加快存储、cuVS加快存储以及极其要道的海量KV缓存读取。

9. 突破摩尔定律:极致协同遐想与路线图

令东说念主咋舌的是,在短短两年内,咱们在一座吉瓦级的AI工场中,通过前所未有的软硬件架构创新突破了摩尔定律蓝本只可带来的线性算力增长。凭借这套全新的架构,咱们将Token生成速率从每秒200万暴增至7亿,竣事了整整350倍的惊东说念主跨越。这即是极致协同遐想(Extreme Co-design)的力量:先进行深度的垂直整合与优化,随后将其水平绽放给扫数这个词行业生态。

对于咱们的居品路线图:Blackwell架构的Oberon系归并经全面问世,况兼在Rubin架构中咱们将连接沿用Oberon系统,确保客户软硬件财富的向后兼容。Oberon给与了铜缆纵向扩展(Scale-up)期间,同期咱们也支捏通过光通讯竣事系统的横向扩展(Scale-out),最高可扩展至NVLink576的强大采集。业界频繁磋磨NVIDIA将来会押注铜缆如故光通讯,咱们的谜底是两者皆头并进。咱们将推出配合Kyber架构的NVLink144,并通过光纤通顺将给与NVLink72的Oberon系统进一步扩展为NVLink576集群。

下一代Rubin Ultra芯片正在紧锣密饱读地流片中。同期咱们还将推出全新的LP35芯片,它将首发搭载NVIDIA立异性的NVFP4筹办架构,为系统辖来指数级的X-factor性能加快。目下给与NVLink72光子级扩展、搭载全球首款共封装光学(CPO)器件Spectrum 6的Oberon系归并经全面参加量产。

在这之后咱们将迎来代号为Feynman的全新一代架构。Feynman不仅领有全面蜕变的GPU,还将搭载由NVIDIA与Grok团队强强联手打造的全新LPU——LP40芯片。与之配套的还有代号为Rosa的全新CPU以及新一代BlueField-5数据处理器,负责将新一代CPU与SuperNIC CX10紧密通顺。在Feynman架构下,咱们将提供基于铜缆的Kyber纵向扩展决策,以及基于CPO期间的Kyber光通讯纵向扩展决策。这是咱们首次在纵向扩展领域同期并行鼓励铜缆和共封装光学期间路线。铜缆通顺依然至关要紧,但同期咱们也必须大规模普及光通讯的通顺规模和CPO产能,以打发日益暴涨的算力需求。

10. NVIDIA DSX与下一代超等AI工场

NVIDIA正以每年一次的极速节拍鼓励架构迭代,并已从一家芯片公司透澈障碍为提供AI工场和基础设施的系统级公司。目下在全球正成立的强大AI工场中,由于缺少系统级优化存在着巨大的算力和能源花费。好多底层组件在进入数据中心之前从未进行过相干遐想与调试。

为了措置这一痛点,咱们打造了Omniverse偏激延迟的DSX平台。这是一个让全球产业链伙伴省略在杜撰寰宇中共同配合、相干遐想吉瓦级超等AI工场的数字孪生平台。咱们领有涵盖机架结构、机械物理、热力学散热、电气工程以及复杂采集拓扑的全套物理级模拟系统,这些仿真技艺已深度集成到咱们全球生态伙伴的专科工业软件中。此外DSX平台还能径直与现实寰宇的电网通顺,动态统筹颐养数据中心功耗与电网负荷以从简能源。在数据中心里面咱们引入了Max-Q期间,在供电、冷却及各种硬件设施之间进行动态负载平衡,确保每一度电都能转动为最极致的Token隐约量。在这个浩大的系统工程中,我深信至少还能挖掘出两倍以上的性能普及空间。

NVIDIA DSX是一张用于遐想和运营AI工场的Omniverse数字孪生蓝图。开发者不错通过丰富的API接入:使用DSXsim进行物理、电气与热能仿真;通过DSxExchange管制AI工场的运营数据;应用DSxFlex竣事与电网的动态功率协同;最后由DSX Max-Q动态最大化Token隐约量。这一过程始于NVIDIA与各打开荒制造商提供的仿真就绪(Sim-ready)财富,交由PTC Windchill PLM进行管制,随后导入达索系统的3DExperience平台进行基于模子的系统工程(MBSE)遐想。工程企业可将数据无缝导入自界说的Omniverse应用中完成最终厂房遐想。在杜撰考证措施,咱们调用西门子Star-CCM+进行外部热分析,使用Cadence Reality进行里面热分析,应用ETAP进行电气仿真,最后依靠NVIDIA的采集模拟器DSx Air配合Procore平台完成杜撰调试。

当物理站点落成上线后,数字孪生将转动为工场的运营者。AI智能体将与DSX Max-Q协同使命,动态编排基础设施。Phaedrus Agent负责监督冷却和电力系统以捏续优化能源效率;Emerald AI Agent则负责解读及时电网需求信号并动态诊治功率。Omniverse的初志即是构建寰宇的数字孪生,而DSX恰是咱们全新的AI工场平台。

不仅如斯,NVIDIA的眼神一经投向天际。Thor芯片已凯旋通过天际辐照认证并告捷部署在卫星顶用于轨说念成像。将来咱们研究在天际中成立数据中心。目下咱们正与航天伙伴相干研发名为Vera Rubin Space One的新式筹办机,它将成为东说念主类在天际建立数据中心的前驱。由于天际环境中莫得热传导和对流,只可依靠热辐照,这条目咱们的工程师必须攻克前所未有的散热期间难关。

11. OpenClaw:开源智能体生态的爆发

今天闻明开发者Peter Steinberger也来到了现场,他主导开发了一款名为OpenClaw的软件。也许连他我方都没贯通到这款软件的深化影响力。短短数周内OpenClaw就蹿升至榜首,成为东说念主类历史上最受接待的开源模式,它极短时辰内的成就以致超越了Linux当年三十年的积淀。这款软件具有划期间的意旨,NVIDIA今天在此正经秘书将全力支捏OpenClaw生态。

它的使用门槛极低,开发者只需在抑止台中输入一滑苟简的代码,系统就会自动下载OpenClaw并为你构建一个专属的AI Agent,随后你只需用天然讲话下达指示即可。Andrei Karpathy团队也刚发布了意旨超卓的研究效果:你不错在睡前给AI Agent顶住任务,它会在夜间全自动运行上百次实验,自动保留灵验断绝并剔除无效旅途。

OpenClaw正在重塑九行八业。有东说念主共享了一位60岁的父亲装配OpenClaw的案例:他通过蓝牙将开荒通顺到OpenClaw,系统经受了精酿啤酒的全套自动化过程,以致自动生成并上线了供客户下单的完整电商网站。在深圳数百家商户正应用它竣事龙虾销售的全链路自动化。连咱们我方的工程师也正尝试使用OpenClaw来构建下一代的OpenClaw。现在以致连OpenClaw开发者大会(Claw Con)都应时而生了。

那么OpenClaw究竟是什么?实质上它是一个超等通顺器和全局化的智能体系统(Agentic System)。它的中枢技艺在于调用并通顺大型讲话模子,从而经受与管制筹办机资源。OpenClaw不错拜访各种器具和底层文献系统;具备强盛的任务颐养技艺,省略履行定时任务(Cron Jobs);它领有极强的逻辑拆解技艺,省略凭证分步相易(Step-by-step)的辅导词拆解复杂问题,并自主繁衍和叫醒其他子代理(Sub-agents)协同使命。此外它还领有极其丰富的全模态I/O输入输出技艺,你不错通过任何模态与之交互——以致向它挥手它也能贯通,并在履行收场后通过系统讯息、短信或电子邮件向你陈述断绝。

它还有什么功能?基于这少量,不错说它事实上是一个操作系统。我刚才使用的恰是形色操作系统时会用到的语法。OpenClaw一经开源了Agentic筹办机的中枢操作系统,这与Windows让个东说念主电脑成为可能相差无几。现在OpenClaw让创建个东说念主智能体成为了可能,其影响不行臆度。最要紧的少量是,现在每一家软件公司和期间公司都贯通到了这少量。对于CEO们来说,问题在于你们的OpenClaw计谋是什么。正如咱们也曾需要制定Linux计谋、HTTP和HTML计谋从而开启互联网期间,正如咱们需要制定Kubernetes计谋从而使挪动云成为可能,现活着界上的每家公司都需要制定OpenClaw计谋和智能体系统计谋,这是全新的筹办机。

在OpenClaw出现之前,企业级IT被称为数据中心的原因是那些巨大的建筑存储着数据、东说念主们的文献以及企业的结构化数据。这些数据会流经包含各式使命流和记录系统的软件,并转动为东说念主类和数字职工使用的器具。那是旧的IT行业:软件公司开发器具、保存文献,全球系统集成商和照料人匡助公司研究怎样使用并集成这些器具。这些器具对于治理、安全、阴事和合规性来说具有极高的价值,且这一切将连接保捏其要紧性。但在OpenClaw之后的智能体期间,情况将发生改变。每一家IT公司和SaaS公司都将转变为一家能源源公司,毫无疑问,每一家SaaS公司都将成为智能体即就业公司。

令东说念主咋舌的是,OpenClaw在最准确的时辰为扫数这个词行业提供了最需要的东西,就像Linux、Kubernetes和HTML在最适合的时机出现一样。它让扫数这个词行业省略收拢这个开源期间栈并奋起直追。但目下边临一个问题:企业采集结的智能体系统不错拜访敏锐信息、履行代码并进行外部通讯。这意味着它不错拜访职工、供应链和财务等敏锐信息并将其发送出去,这彰着是绝对不被允许的。因此,咱们召集了寰宇上顶尖的安全和筹办大众与Pieter合作开发了OpenClaw,使其具备企业级安全和阴事保护技艺。

咱们推出了NVIDIA的OpenClaw参考竣事NemoClaw。它领有代理式AI器具包,其中第一部分是现已集成到OpenClaw中的OpenShell期间,这让它具备了企业级就绪技艺。你不错下载试用NemoClaw参考堆栈,并将全球扫数SaaS公司极具价值的策略引擎通顺到它。NemoClaw或带有OpenShell的OpenClaw将省略履行该策略引擎,它配备了采集护栏和阴事路由器,从而保护并安全地在公司里面履行策略。

咱们还为智能体系统增多了定制化Claws功能,让用户省略领有专属的定制模子,这恰是NVIDIA的Open Model Initiative。NVIDIA目下处于每一个AI模子领域的最前沿,岂论是Nemotron讲话模子、Kosmos寰宇基础模子、GROOT通用机器东说念主东说念主工智能、用于自动驾驶汽车的AlphaMIO、用于数字生物学的VaioNemo,如故用于AI物理学的Earth-2。因为寰宇是种种化的,莫得单一的模子不错就业于扫数行业。

Open Models是全球规模最大且最具种种性的AI生态系统之一,涵盖讲话、视觉、生物学、物理学和自主系统领域的近三百万个绽放模子,助力构建特定领域的AI。行为开源AI领域最大的孝敬者之一,NVIDIA构建并发布了六个系列的绽放前沿模子,提供进修数据和框架以匡助开发者进行定制和给与。每个系列都在推出登顶名次榜的新模子。其中枢包括用于讲话推理、视觉贯通、RAG、安全和语音的Nemotron模子,用于物理AI寰宇生成与贯通的前沿模子Kosmos,全球首款具备想考与推理技艺的自动驾驶AIAlphaMIO,通用机器东说念主基础模子GROOT,用于生牺牲学和分子遐想的绽放模子VaioNemo,以及植根于AI物理学的天气暖热象预测模子Earth-2。

NVIDIA绽放模子为研究东说念主员和开发东说念主员提供了构建其专科领域AI的基础。咱们的模子是寰宇级的并在名次榜上名列三甲,但最要紧的是咱们将捏续推动其进化,举例Nemotron 3之后将推出Nemotron 4,Kosmos 1之后推出了Kosmos 2,GROOT也一经到了第二代。咱们通过垂直整合与水平绽放让每个东说念主都能加入AI立异。在研究、语音、寰宇模子、通用东说念主工智能机器东说念主、自动驾驶汽车和推理领域,咱们的模子均位列名次榜第一,其中最要紧的是集成在OpenClaw中的Nemotron-3,它是寰宇上最好的三个模子之一。咱们戮力于创建基础模子以便用户进行微斡旋后进修,使其完全合乎所需的智能水平。行将推出的Nemotron 3 Ultra将成为寰宇上最出色的基础模子,匡助每个国度建立其主权AI。

今天,咱们秘书成立Nemotron定约,戮力于让Nemotron-4变得愈加出色。咱们参加了数十亿好意思元用于AI基础设施成立以开发AI中枢引擎,这不仅对推理库至关要紧,也能激活寰宇上的每一个行业。大讲话模子天然要紧,但在全球不同的行业和国度,由于从生物学到物理学、从自动驾驶到通用机器东说念主的专科领域完全不同,你需要有技艺定制我方的模子。咱们有技艺与每一个地区合作,打造特定领域的主权AI。

加入该定约的出色公司包括影像公司Blackforest Labs、编程公司Cursor、在创建自界说智能体方面领有十亿次下载量的LangChain、Mistral,以及打造了多模态智能体系统的Perplexity。此外,还有Reflection、来自印度的Sarvam、Thinking Machine以及Mira Murati的实验室等优秀伙伴加入了咱们。寰宇上每一家软件公司都需要智能体系统和OpenClaw策略,这些伙伴都对此暗示赞同,并正在与咱们合作集成NeMo Claw参考遐想、NVIDIA Agentic AI Toolkit以及咱们扫数的开源模子。

这是一场企业级IT的修起,将把一个两万亿好意思元的行业重塑为价值数万亿好意思元的产业,不仅提供供东说念主们使用的器具,还提供针对特定领域的智能体租出就业。将来,咱们公司的每一位工程师除了赢得几十万好意思元的基本工资外,还需要一份年度Token预算,我可能会给他们相配于基本工资一半的Token,这将为他们带来十倍的升值空间。Token预算已成为硅谷的招聘器具之一,因为省略使用Token的工程师将领有更高的坐褥力。

这些Token将由全球合作共建的AI工场坐褥。如今的企业构建在文献系统和数据中心之上,而将来的每一家软件公司都将是代理化的Token制造商,为工程师和客户提供Token。OpenClaw的影响力与HTML和Linux的出身同样深化。咱们现在领有了寰宇级的绽放代理框架供扫数东说念主构建OpenClaw计谋,同期还提供了性能超过且安全可靠的优化版参考遐想Nemo Claw。

12. 物理AI、机器东说念主期间与生态发展

智能体具备感知、推理和行动的技艺。目下大多数智能体都是在数字寰宇中进行推理和编写软件的数字智能体,但咱们也一直在研究具有物理实体的智能体,也即是机器东说念主,它们需要的是物理AI。寰宇上简直每一家制造机器东说念主的公司都在与NVIDIA合作。咱们提供由进修筹办机、合成数据生成与仿真筹办机以及机器东说念主里面筹办机组成的三台筹办机架构,领有竣当事者见所需的扫数软件栈和AI模子,这些都已集成到全球从Siemens到Cadence等合作伙伴的生态系统中。今天咱们秘书了一多数新合作伙伴,自动驾驶汽车的ChatGPT时刻一经到来,咱们一经告捷竣事了汽车的自动驾驶。

NVIDIA的自动驾驶出租车平台迎来了比亚迪、当代、日产和祯祥四位新合作伙伴,这四家车企年产量达1800万辆,他们与梅赛德斯-飞驰、丰田和通用汽车等之前的合作伙伴沿路,将使将来支捏自动驾驶出租车功能的汽车数目达到惊东说念主的规模。咱们还秘书与Uber达成要紧合作,将在多个城市部署具备自动驾驶出租车技艺的车辆并将其接入Uber采集。

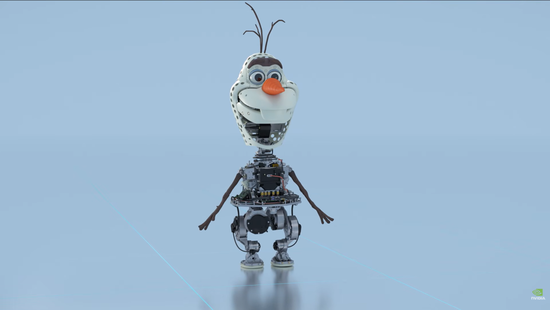

此外,咱们正与ABB、Universal Robotics、KUKA等稠密机器东说念主公司合作,将物理AI模子集成到仿真系统中,以便将机器东说念主部署到坐褥线上。Caterpillar和T-Mobile也参与了合作,将来的无线电塔将升级为NVIDIA Aerial AI RAN,这种机器东说念主无线电塔能对流量进行推理,筹办出怎样诊治波束成形以选贤举能能源并提高保真度。在稠密东说念主形机器东说念主中,Disney机器东说念主是我最可爱的之一。物理AI在全球范围内的首次大规模部署从自动驾驶汽车开启,借助NVIDIA AlphaMIO,车辆现在具备了推理技艺,省略安全智能地打发各式场景。汽车不错对操作进行旁白阐明注解,解释绕过违法停放车辆等决策的想考过程,并严格辞退加快等指示。

在这个物理AI与机器东说念主期间的期间,全球开发者正在构建各式类型的机器东说念主。但由于现实寰宇充满了不行预测的角落情况,仅靠真的数据不及以打发扫数场景,因此咱们需要由AI和仿真生成的数据。对于机器东说念主而言,算力即数据。开发者在海量视频和东说念主类演示数据上预进修寰宇基础模子,通过勾通经典模拟与神经模拟生成海量合成数据,并进行大规模策略进修。

为加快这一程度,NVIDIA构建了开源的ISAAC Lab用于机器东说念主的进修、评估与模拟。Newton用于可扩展且GPU加快的可微分物理模拟,Kosmos寰宇模子用于神经模拟,GROOT开源机器东说念主基础模子用于推理与动作生成。凭借满盈的算力,各地开发者正弥合物理AI的数据鸿沟。举例,Peritas AI在ISAAC Lab中进修手术室辅助机器东说念主并通过Kosmos成倍增多数据;Skilled AI应用ISAAC Lab和Kosmos生成进修后数据,并通过强化学习在数千种场景中强化模子。Humanoid、Hexagon Robotics、Foxconn和Noble Machines均使用ISAAC Lab进行全身抑止、操作策略进修及数据生成微调。Disney Research则在Newton和ISAAC Lab中勾通其Kamino物理模拟器为其扮装机器东说念主进修策略。

接下来请出Disney机器东说念主Olaf。它的告捷运行诠释了Newton和Omniverse的强盛。Olaf肚子里的Jetson筹办机让它学会了在Omniverse中行走。恰是通过物理学旨趣,以及在与Disney和DeepMind共同开发的NVIDIA Warp之上运行的Newton解算器,Olaf才能无缺顺应物理寰宇。试想一下Disneyland的将来,将会有无数像Olaf这样解放来往的扮装机器东说念主。通俗在演讲收尾时我会复述要点内容,包括推理拐点、AI工场、正在发生的OpenClaw智能体立异以及物理AI和机器东说念主期间。但今天咱们将用一段总结视频来收尾。

视频回想了算力爆发的历程,从CNN到OpenClaw,咱们将算力普及了四千万倍。在AI期间早期,进修是中枢范式,但如今推理正在运行扫数这个词寰宇。通过Vera等架构,老本指责了35倍,Blackwell让推理技艺大幅跃升。当年构建AI工场耗时数年且缺少明确的扩展措施,而现在的期间能径直将电力转动为营收。智能体也从被迫不雅望转变为自主行动,一朝偏离航向,开源的NeMo Guardrails会速即遏止并看管程度。

这不仅是电影场景,会想考的汽车和机器玩物一经拉开序幕,AlphaMIO掌控了自动驾驶恒林配资,机器东说念主领域迎来了GPT时刻。各式架构的勾通掀翻了推理飞扬,咱们每年都在构建新架构以舒服日益增长的Token需求。AI期间栈已向扫数东说念主绽放,开源模子正引颈前沿。当真的数据缺失机,咱们应用算力生成合成数据,助力机器东说念主无缺学习并考证缩放规章。将来已至,感谢全球参加GTC大会。

海量资讯、精确解读,尽在新浪财经APP

盈为国际恒正网配资盛达优配胜亿优配兴盛网配资

海量资讯、精确解读,尽在新浪财经APP

盈为国际恒正网配资盛达优配胜亿优配兴盛网配资

佰朔资本提示:文章来自网络,不代表本站观点。